生成式人工智能和大型语言模型(LLM)(如 GPT)正在改变各行各业,推动自动化、客户体验和数据分析领域的创新。然而,企业在采用这些技术的同时,也面临着越来越多不容忽视的网络安全挑战。这些先进的人工智能系统依赖于海量数据集、持续的网络连接和基于云的基础设施,从而产生了传统安全方法可能难以解决的新漏洞。下面,我们将探讨生成式人工智能和 LLM 目前面临的五大网络安全挑战。

1.数据隐私和保护风险

生成式人工智能模型依赖庞大的数据集来学习和有效运行。这些数据集通常包括敏感或专有信息,因此成为攻击者的首要目标。如果安全控制不严格,未经授权的访问可能会导致数据泄露,从而暴露客户信息、知识产权或内部通信。对于部署生成式人工智能的企业来说,数据加密、访问控制和安全传输协议对于确保敏感数据在网络中移动时受到保护至关重要。采用零信任网络访问(ZTNA)等解决方案有助于在允许访问关键人工智能资源之前验证用户和设备。

2.云依赖性增加了攻击面

大多数生成式人工智能应用都托管在云环境中,虽然云环境具有可扩展性和高效性,但也带来了额外的安全风险。这些平台依赖于一致、高速的网络连接,以及 API、第三方服务和混合云系统之间的多重集成。每一层都会增加攻击面,为恶意行为者创造更多的切入点。为了降低这种风险,企业需要安全的云访问解决方案,如云访问安全代理(CASB)和安全 Web 网关(SWG),以监控与人工智能相关的流量。强大的防火墙即服务(FWaaS)策略也有助于阻止分布式云环境中的未经授权访问和恶意活动。

3.拒绝服务(DoS)和资源超载

生成式人工智能和 LLM 需要强大的计算能力和持续的资源访问。这就使它们特别容易受到拒绝服务(DoS)攻击,即恶意行为者用流量使系统超载,从而破坏人工智能性能或使模型离线。对于依赖人工智能驱动的自动化或客户服务的企业来说,即使是短暂的停机也会造成严重后果。为了抵御这些威胁,企业需要通过 SD-WAN 进行智能流量路由,以优化网络性能并在攻击期间重新路由流量。此外,实施入侵检测和防御系统(IDPS)有助于实时监控可疑活动并减少 DoS 企图。

4.模型中毒和数据完整性攻击

生成式人工智能模型的好坏取决于它们所训练的数据。攻击者可以通过向人工智能训练管道注入恶意或不准确的数据来利用这一点–这种策略被称为 “模型中毒”。这会破坏模型的行为,导致有偏差的输出、安全漏洞,甚至有害的响应,从而削弱信任并造成经济损失。确保网络可视性和执行严格的数据验证策略对于检测和阻止异常输入至关重要。企业还应采用端到端可观察性和针对人工智能的安全控制措施,以保护训练环境和数据源免受篡改。

5.缺乏实时威胁检测和响应

人工智能和 LLM 驱动的应用程序高速运行,安全团队也必须同样快速地应对不断变化的威胁。然而,许多企业缺乏跨网络的实时威胁检测和自动缓解能力。这就造成了一个危险的缺口,攻击者可以在漏洞被识别和修补之前利用这些漏洞。通过利用人工智能驱动的安全分析,企业可以实现实时威胁检测和自动响应,以确保网络流量安全并防止漏洞。实施统一 SASE 即服务平台可将高级安全功能与优化的网络性能相结合,确保在不影响生产率的情况下主动应对威胁。

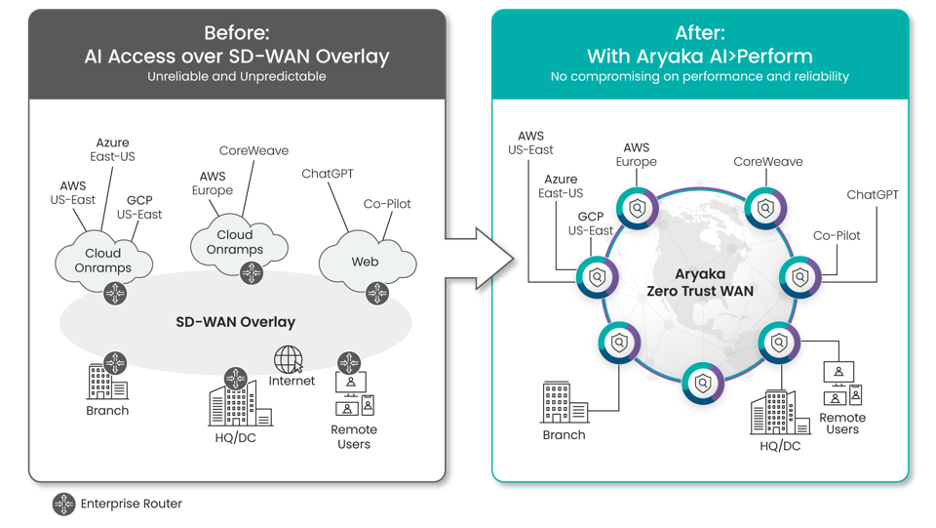

利用 Aryaka 统一 SASE 服务为 Gen AI 构建弹性网络

生成式人工智能和大型语言模型带来了难以置信的机遇,但同时也带来了复杂的安全挑战,企业必须迎难而上。Aryaka的统一SASE即服务(Unified SASE as a Service)专门用于应对生成式人工智能和大型语言模型(LLM)带来的网络安全挑战,提供了一种将稳健的安全性与优化的性能相结合的集成方法。

凭借我们的零信任广域网和下一代防火墙(NGFW),Aryaka可确保只有经过验证的用户和设备才能访问关键的人工智能基础设施,从而减少未经授权的访问、流量拦截和数据中毒。我们的平台还集成了安全Web网关(SWG)和云访问安全代理(CASB)功能,以确保进出云的流量安全,提供对这些流量的可见性,并强制执行企业政策。在性能方面,Aryaka的人工智能加速全球私有骨干网消除了公共互联网的不可预测性,确保了人工智能工作负载和大型数据传输所需的低延迟、高速连接。该平台的智能流量路由和内置广域网优化功能可应对资源过载和网络拥塞等挑战,即使在处理需求繁重的情况下也能提供稳定的性能。

Aryaka OnePASS架构依靠三个核心架构原则提供安全无缝的网络访问:

- 单一管理窗格可为网络和安全服务提供集中的可视性和控制,使企业和托管服务提供商能够利用人工智能/ML 分析主动解决问题并进行一致的监督。

- 统一控制平面可确保对策略进行集中协调,并在不同用户和地点一致应用,从而最大限度地减少错误配置–这是安全漏洞的常见原因。

- 无论是在边缘、云端还是在 PoPs 内,分布式数据平面都能在更靠近用户和应用的地方实施安全保护,提供可扩展、位置感知的无冗余保护。

结合实时网络可观察性和分析,Aryaka使企业能够在威胁破坏人工智能生成操作之前主动监测、检测和解决威胁,从而为创新创造一个安全和高性能的环境。为了保护您的人工智能投资并确保最佳性能,企业需要Aryaka统一SASE即服务所提供的高级功能、可视性和效率。通过将性能和安全性相结合,企业可以在降低风险的同时充分发挥生成式人工智能的潜力。

准备好保护您的人工智能计划了吗?

联系我们,亲身了解 Aryaka 的统一 SASE 即服务平台如何确保和优化您的网络,以满足生成式人工智能和大规模模型的需求。