L’évolution des réseaux WAN et de la sécurité des réseaux a été rapide au cours des 20 dernières années.

L’évolution des réseaux WAN et de la sécurité des réseaux a été rapide au cours des 20 dernières années.

Avant 2000, les réseaux WAN étaient relativement simples, avec des réseaux privés (tels que MPLS et lignes louées) combinés à des pare-feu centralisés placés au siège et dans les centres de données.

À cette époque, la plupart des employés travaillaient depuis leur bureau et étaient reliés à un câble ; il n’y avait pas de « nuage » à proprement parler.

Les travailleurs à distance étaient connectés à un concentrateur VPN central.

Si les réseaux privés offraient une expérience contrôlée de haute performance, ils étaient coûteux.

Toutefois, compte tenu du nombre limité de travailleurs à distance, une expérience médiocre n’était pas considérée comme un problème important.

Il n’y avait pratiquement pas de pare-feu dans les succursales, et un pare-feu central protégeait les connexions à l’internet.

Les équipes chargées du réseau et de la sécurité étaient organisées en silos distincts et ne collaboraient qu’occasionnellement.

Au cours des 25 dernières années, une multitude de nouvelles technologies ont bouleversé l’ordre établi, notamment le Wi-Fi en 1997, l’internet à large bande en 2000, l’optimisation des réseaux étendus en 2002, les services en nuage en 2006, la sécurité en nuage en 2008, le SD-WAN en 2012 et le SASE (Secure Access Service Edge) en 2019.

En conséquence, les organisations informatiques et de sécurité ont été confrontées à trois questions fondamentales : Première question : où placer le point d’accès à l’internet ? Avant que le Wi-Fi ne devienne omniprésent, il était courant d’acheminer l’ensemble du trafic internet via le réseau étendu privé vers un emplacement central où un ensemble de pare-feu protégeait le périmètre de l’entreprise.

Cependant, avec la généralisation du Wi-Fi et de l’adoption de l’informatique dématérialisée, l’acheminement de quantités massives de trafic internet via des liaisons privées coûteuses a commencé à compromettre les performances des applications.

Par conséquent, la tendance est de plus en plus à placer les points d’accès à l’internet dans les succursales et à y déployer des pare-feux, malgré le coût supplémentaire et le risque accru pour la sécurité.

La sécurité dans le nuage est venue à la rescousse en 2008, offrant une solution idéale pour les petites entreprises et les travailleurs à distance, leur permettant de garder les pare-feu à l’écart des locaux et d’éliminer les risques pour les utilisateurs distants.

Pour les grands sites et les centres de données, le pare-feu NextGen sur site est resté en place, ce qui a posé le problème de la répartition des politiques de sécurité entre la sécurité sur site et la sécurité dans le nuage. Deuxième question : Comment l’internet moins cher peut-il être utilisé pour réduire les coûts des réseaux étendus des entreprises ? La plupart des entreprises se sont abstenues de connecter leurs bureaux directement à l’internet pour des raisons de simplicité et de sécurité.

Toutefois, à mesure que le Wi-Fi et l’adoption du cloud ont forcé la main des responsables informatiques et que l’internet a été introduit dans tous les bureaux, la connectivité internet a été de plus en plus considérée comme une opportunité de réduire les dépenses liées au réseau étendu.

C’est ce qui a conduit à l’adoption du SD-WAN, qui utilise des capacités de pilotage et d’optimisation des chemins pour fournir les performances requises aux applications en utilisant le chemin optimal (internet ou MPLS) lorsque cela est nécessaire.

Le plus grand avantage du SD-WAN était la réduction des coûts en réduisant autant que possible le besoin de MPLS coûteux (et inflexible) en dirigeant le trafic WAN sur des circuits internet.

Aujourd’hui, de nombreuses entreprises ont même supprimé le MPLS et l’ont remplacé par des liaisons internet (doubles).

Cependant, l’internet est une technologie « best-effort » avec des latences incohérentes et sans garantie de bande passante.

D’où le besoin émergent d’un internet amélioré, avec une garantie de disponibilité et des latences plus prévisibles.

En outre, avec l’explosion des applications sur le réseau étendu, les gestionnaires de réseau veulent éliminer toute cause de performances médiocres des applications.

Par ailleurs, avec l’augmentation du travail en tout lieu, il est devenu évident que les travailleurs à distance devaient bénéficier de la même expérience que les employés de bureau.

Les solutions SD-WAN traditionnelles se concentrent principalement sur la connectivité des bureaux, ce qui se traduit souvent par une complexité accrue du réseau et des frais généraux de gestion plus élevés. Troisième question : Quelle est l’architecture de montée en charge la mieux adaptée à l’évolution constante des besoins en matière d’informatique dématérialisée ? Avec l’adoption généralisée des services en nuage, les entreprises sont désormais confrontées au défi de la gestion des connexions entre leur réseau étendu et les fournisseurs de services en nuage.

Pour ce faire, il est nécessaire de mettre en place des rampes d’accès au nuage spécifiques qui regroupent les connexions de plusieurs bureaux et utilisateurs distants sur une seule liaison vers l’emplacement IaaS d’un fournisseur de nuage spécifique.

Les « cloud-onramps » sont coûteux, car chaque rampe d’accès nécessite des points d’agrégation spécifiques dans un lieu donné.

En outre, ces rampes en nuage doivent s’inscrire dans le cadre de sécurité global de l’entreprise, qui implique souvent une combinaison de pare-feu sur site et de sécurité en nuage couvrant à la fois le cas d’utilisation de l’Internet et les connexions de site à site. Le résultat final : Les organisations informatiques sont coincées avec des réseaux Frankenstein ». Les organisations informatiques se sont efforcées de trouver des réponses simples aux trois questions susmentionnées et sont maintenant confrontées à une situation complexe et difficile.

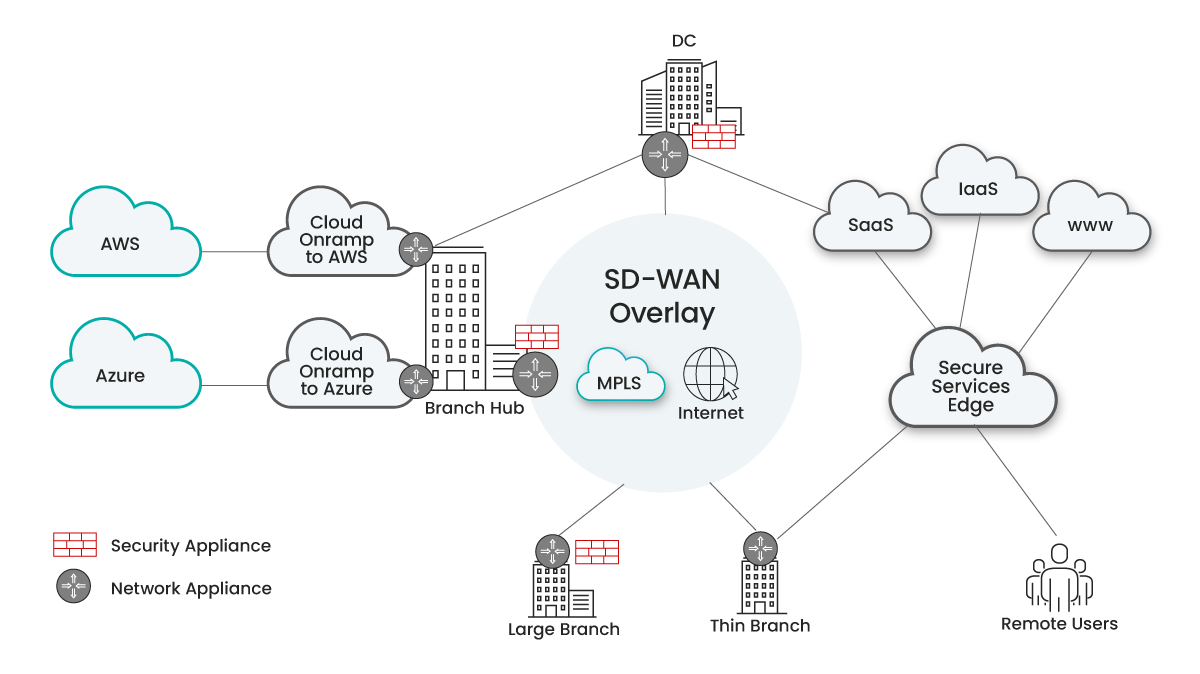

Ils se retrouvent avec un patchwork de mises en œuvre distinctes pour le SDWAN afin de connecter les succursales, les cloud-onramps et les mises en œuvre de sécurité pour le cloud et la sécurité sur site.

Ces différentes implémentations proviennent souvent de plusieurs fournisseurs et sont dotées d’outils de gestion distincts, ce qui aboutit à une solution complexe et lourde à gérer et à entretenir.

Ce « réseau Frankenstein » est complexe et se traduit par des performances médiocres, des politiques de sécurité incohérentes et un manque de visibilité et de contrôle, ce qui rend difficile la résolution rapide et efficace des problèmes.

Les réseaux Frankenstein typiques d’aujourd’hui

« La solution SASE d’Aryaka : La fin des réseaux Frankenstein »

La montée en puissance des réseaux Frankenstein a poussé les organisations informatiques à chercher une solution, et le SASE est apparu comme la réponse.

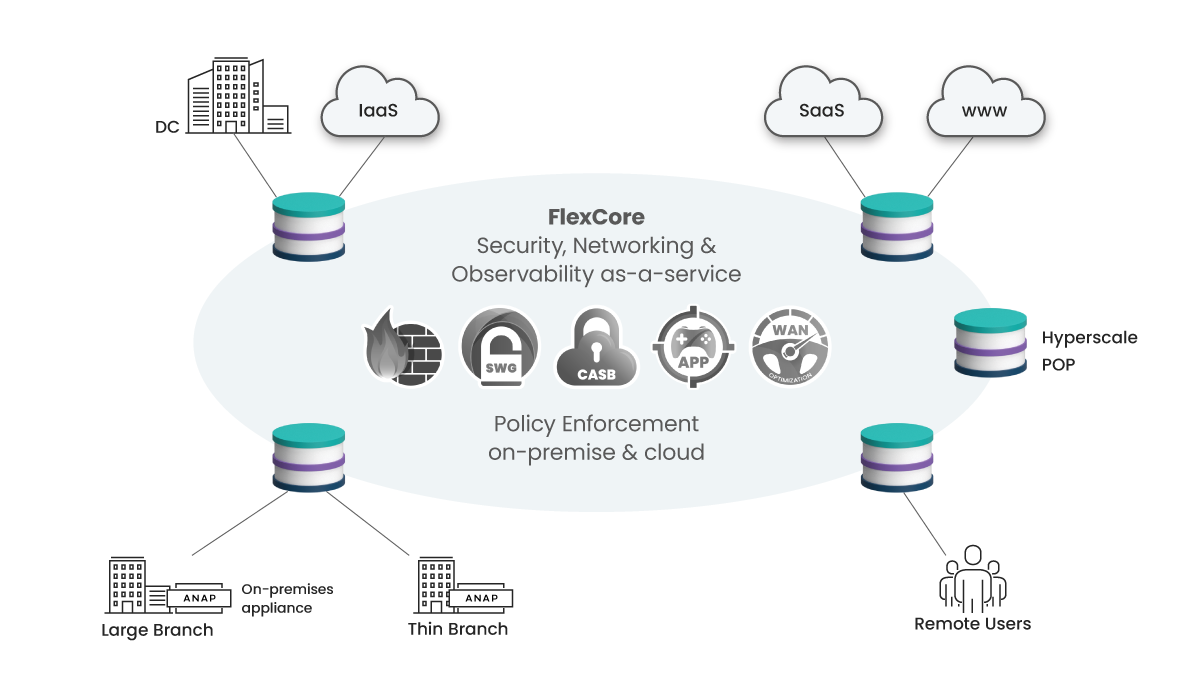

L’approche d’Aryaka en matière de SASE commence par une fondation de réseau de haute performance, permettant des connexions sécurisées entre les utilisateurs et les applications, quel que soit l’endroit, le tout dans le cadre d’un ensemble de politiques entièrement unifiées pour le réseau et la sécurité.

En appliquant les politiques de sécurité aussi près que possible des utilisateurs et des applications, que ce soit dans le nuage ou sur site, les goulets d’étranglement en matière de performance sont éliminés conformément aux principes de la confiance zéro.

La base du réseau doit éliminer le patchwork inflexible de réseaux séparés reliant les succursales, les utilisateurs, les centres de données et le nuage, et être fournie sous forme de service consommable dans le nuage, y compris les fonctionnalités sur site.

En outre, une infrastructure réseau flexible doit offrir trois niveaux de service pour optimiser les dépenses WAN : best-effort internet, better-than-internet et better-than-MPLS, tout en éliminant complètement l’ancien MPLS.

Il est souvent intéressant de noter que les implémentations SASE actuelles d’un seul fournisseur semblent être des solutions SASE au niveau de la surface, mais sous le capot, elles peuvent encore être des réseaux Frankenstein qui n’ont pas nettoyé l’architecture sous-jacente.

SASE unifié d’Aryaka sur la base FlexCore d’Aryaka

Les résultats de l’approche d’Aryaka fournissent une solution SASE facile à consommer qui profite aux clients en offrant une expérience hautement sécurisée et performante pour tous les utilisateurs, applications et charges de travail.

Cette facilité d’utilisation est établie par une infrastructure cloud-native consistant en un contrôle déterministe du réseau sous-jacent, combiné à une architecture à chemin unique de fonctions de réseau, d’optimisation et de sécurité avec des flux de travail de service intégrés.

L’agilité et la flexibilité sont les avantages fondamentaux pour les clients, car ils peuvent désormais faire évoluer leur infrastructure de réseau et de sécurité au rythme de la transformation numérique sans fin.

De plus, avec cette approche, les utilisateurs peuvent rapidement se déplacer et les succursales peuvent être relocalisées sans avoir à remplacer constamment les technologies et les fournisseurs tous les quelques années, à mesure que de nouveaux défis se présentent.

En outre, les coûteux cloud-onramps peuvent être éliminés sans nécessiter de mises à niveau onéreuses de l’infrastructure réseau.

Les accords de niveau de service (SLA) du réseau, qui vont du meilleur effort à la performance garantie des applications, peuvent être modifiés instantanément en fonction des besoins des utilisateurs et de la nature des applications.

La solution SASE d’Aryaka, avec sa facilité de consommation, son agilité, sa flexibilité et ses services gérés, fournit aux clients un outil puissant pour éliminer les réseaux Frankenstein et prendre le contrôle de leur infrastructure de réseau et de sécurité.